تأثیر بالقوه مقررات جدید هوش مصنوعی

تأثیر بالقوه مقررات جدید هوش مصنوعی – نشریه ایساکا شماره 1 – 2024 صفحات 27-32

مترجم: داود رجب زاده

این مقاله توسط هیچ ربات چت مولد هوش مصنوعی (AI) نوشته نشده است.

این سلب مسئولیت سال گذشته اهمیتی نداشت. با این حال، هوش مصنوعی رونق قابل توجهی را تجربه کرده است. در نتیجه، به طور ناگهانی و گسترده متوجه شدیم که هوش مصنوعی چیزی نیست که بتوان آن را نادیده گرفت – چه به این دلیل که باعث ایجاد ترس در افرادی می شود که از پتانسیل آن آگاه نیستند یا به این دلیل که هیجان زیادی در مورد آنچه می تواند انجام دهد ایجاد می کند.

نیاز مبرمی به مقرراتی وجود دارد که به استفاده، سوء استفاده و چالش های اخلاقی داده های تولید شده رسیدگی کند.

هوش مصنوعی اصطلاحی است که اغلب با عباراتی مانند یادگیری ماشینی (یادگیری ماشینی زیرشاخه ای از هوش مصنوعی است که به طور کلی به عنوان توانایی ماشین برای تقلید از رفتار هوشمند انسان تعریف می شود. سیستمهای هوش مصنوعی برای انجام وظایف پیچیده به روشی مشابه نحوه حل مشکلات انسانها استفاده میشوند؛ توضیح مترجم از ML) یا مدلهای زبان بزرگ (مدل زبان بزرگ یک الگوریتم یادگیری عمیق است که برای خلاصه کردن، ترجمه، پیشبینی و تولید متن برای انتقال ایدهها و مفاهیم مجهز است. مدلهای زبان بزرگ برای انجام آن توابع به مجموعه دادههای بسیار بزرگ متکی هستند. این مجموعه داده ها می تواند شامل 100 میلیون یا بیشتر پارامتر باشد که هر کدام نشان دهنده متغیری است که مدل زبان از آن برای استنتاج محتوای جدید استفاده می کند؛ توضیح مترجم از MLL) اشتباه گرفته میشود.

در میان پتانسیل و هیجان پیرامون فناوریهای هوش مصنوعی نوظهور و تأثیر آنها، رهبران صنعت، سازمانهای دولتی و شرکتها در حال بحث درباره مداخلات نظارتی مانند قانون هوش مصنوعی اتحادیه اروپا (EU)، قانون هوش مصنوعی ایالت نیویورک (محدود کردن استفاده از ابزارهای تصمیم گیری شغلی خودکار) هستند و تقریباً 30 پیشنهاد دیگر مرتبط با هوش مصنوعی در سرتاسر جهان در حال پخش است. اجرای مقررات تأثیرات عمیقی بر بخشهای مختلف از جمله آموزش، حفظ حریم خصوصی دادهها، علوم زیستی و تحقیقات خواهد داشت.

تجزیه و تحلیل تأثیر هوش مصنوعی موضوعات کلیدی را نشان می دهد که بر تأثیر مقررات، لوایح و قوانین تأکید می کند. هدف تجزیه و تحلیل، کنار هم قرار دادن وضعیت فعلی با وضعیت مطلوب آینده است، از این طریق نیاز به مقررات تاثیرگذار و همچنین افزایش آگاهی عمومی در مورد اینکه چگونه مقررات می توانند به طور مثبت زمینه هوش مصنوعی را بهبود بخشند، ارزیابی می شود.

انواع مداخلات نظارتی در سراسر جهان

چین، اتحادیه اروپا، بریتانیا و ایالات متحده هر کدام الزامات نظارتی را تعیین کرده اند که به تغییر چشم انداز هوش مصنوعی می پردازد. اخیراً قانون هوش مصنوعی اتحادیه اروپا زمینه را برای توسعه بیشتر چارچوب مدیریت ریسک فراهم کرده است.

چین رویکرد متفاوتی اتخاذ کرده است و سه اقدام قانونی متمایز را که با دیدگاههای ملی، منطقهای و محلی هماهنگ است اتخاذ کرده است. آخرین، پیوند عمیق مقررات در چین، در سال 2023 اجرایی شد.

اگرچه کشورهای دیگر سعی کردهاند مقررات متفاوتی را وضع و اجرا کنند، اما تعداد زیادی از آنها با سرعت تکامل ابزارها و الگوریتمهای یادگیری ماشینی و هوش مصنوعی (هوش مصنوعی، در معنای وسیع آن، هوشی است که توسط ماشینها، بهویژه سیستمهای کامپیوتری، در مقابل هوش طبیعی موجودات زنده به نمایش گذاشته میشود؛ توضیح مترجم از AI) هماهنگ نشدهاند.

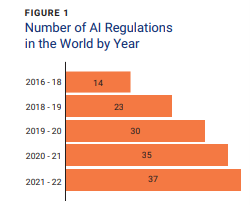

شکل 1 افزایش سالانه قوانین و مقرراتی را نشان می دهد که عبارت «هوش مصنوعی» را در خود جای داده است.

نهادهای قانونگذاری در 127 کشور در چند سال گذشته 37 قانون را تصویب کردند که شامل هوش مصنوعی میشد، که بر ارتباط هوش مصنوعی در بحث نظارتی تأکید میکند.

کشورهای سراسر جهان، از جمله کانادا، چین، اسپانیا، بریتانیا و ایالات متحده، در تلاش برای رسیدگی به نگرانیهای اخلاقی که در این زمینه از دانش پدید آمده اند و به سرعت در حال پیشرفت هستند(مانند سوگیری دادهها، اصالت منابع ویژه یک منطقه یا کشور) لوایح ویژه هوش مصنوعی را تهیه و قوانین و مقرراتی را تصویب کردهاند. برخی از این مناطق از یک رویکرد بخشی برای تنظیم هوش مصنوعی (به عنوان مثال، ویژه حریم خصوصی داده ها یا محتوای خاص) استفاده می کنند، در حالی که برخی دیگر، مانند چین و ایالات متحده، در تهیه پیشنویس این مقررات، با درک از نحوه عملکرد مدلها و الگوریتمهای هوش مصنوعی و یادگیری ماشینی، بر چندین حوزه اجرای قوانین (به عنوان مثال، شفافیت، سوگیری و حفاظت از داده ها) که فضا برای بهبود وجود دارد تمرکز می کنند.

آشنایی با مدل های هوش مصنوعی و یادگیری ماشینی

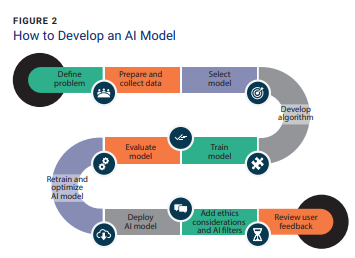

مدلهای هوش مصنوعی و یادگیری ماشینی (بر اساس الگوریتمها) به چندین ورودی متکی هستند که ورودی اصلی داده است. داده ها برای تولید مجموعه داده های آموزشی با استفاده از مدل های هوش مصنوعی و یادگیری ماشینی از قبل شناخته شده و برای به دست آوردن یک نتیجه یا اثر خاص استفاده می شود. بیشتر مدل ها داده ها را تفسیر می کنند و توصیه هایی را برای حل مسائل مربوط به مشکلات خاص ارائه می دهند. شکل 2 مراحل توسعه یک مدل هوش مصنوعی را نشان می دهد.

شبکههای عصبی عمیق، رگرسیون لجستیک و خطی، درختهای تصمیمگیری، k-نزدیکترین همسایه، جنگل تصادفی و طبقه بندی ساده برخی از مدلهای الگوریتمی رایج هستند. این مدلها معمولاً بر اساس مکانهایی که میتوان آنها را در یک سازمان یا از طریق یک سیستم اعمال کرد، دستهبندی میشوند.

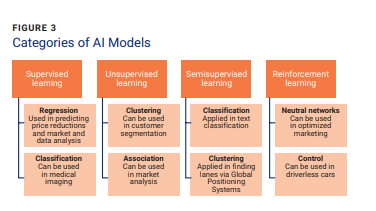

شکل 3 دسته بندی مدل های هوش مصنوعی و حوزه های کاربردی آنها را به تصویر می کشد.

هر مدل یادگیری مبتنی بر هوش مصنوعی، یادگیری را از طریق رویکردهای آماری که از یادگیری ماشینی از مجموعه دادهها پشتیبانی میکنند، امکانپذیر میسازد. چهار دسته از یادگیری مدل هوش مصنوعی وجود دارد:

- یادگیری تحت نظارت شامل یادگیری از مجموعه داده های برچسب گذاری شده یا داده های جمع آوری شده از تجربه است.

- یادگیری نیمه نظارتی شامل دو مجموعه داده - یکی که داده برچسب گذاری شده و دیگری بدون برچسب است.

- یادگیری بدون نظارت دستگاه را قادر می سازد تا با داده هایی که برچسب گذاری نشده اند یاد بگیرد.

- یادگیری تقویتی مبتنی بر مجموعه ای از نتایج مثبت یا منفی در رابطه با یک هدف یادگیری است.

یادگیری تحت نظارت: پسرفت در پیش بینی کاهش قیمت و تحلیل بازار و داده ها استفاده می شود

طبقه بندی قابل استفاده در تصویربرداری پزشکی

یادگیری نظارت نشده: خوشه بندی می تواند در بخش بندی مشتریان استفاده شود

اتحادیه می تواند در تجزیه و تحلیل بازار استفاده شود

یادگیری نیمه نظارت شده: طبقه بندی در طبقه بندی متن اعمال می شود

خوشه بندی در یافتن خطوط از طریق سیستم های موقعیت یاب جهانی استفاده می شود

تقویت یادگیری: شبکه های خنثی می تواند در بازاریابی بهینه استفاده شود

کنترل قابل استفاده در خودروهای بدون راننده

تأثیر مقررات بر هوش مصنوعی چیست؟

این نقش دولت ها است که در مورد مسائل مربوط به انصاف، اصالت و محدودیت های محتوا بحث کنند (برخی از بزرگترین ملاحظات نظارتی). بسیاری از قوانین و مقررات هوش مصنوعی موجود، پیامدهای گسترده ای را برای LLM ها، چت ربات های مولد هوش مصنوعی و الگوریتم های پردازش زبان طبیعی ایجاد می کنند. متخصصان و سازمانهای فناوری اطلاعات در سراسر جهان باید تأثیر فعلی و آتی مقررات را بررسی کنند تا بفهمند که در کجا ممکن است مداخله نظارتی بیشتری مورد نیاز باشد.

تاثیر مقررات اخیر

مقررات موجود، فراتر از دستورالعملها و ممنوعیتهای تجویز شده، به تأثیرات واقعی عمیقتر (مانند ترویج شیوههای اخلاقی در مورد کودکان یا نحوه برنامهریزی مدلهای هوش مصنوعی برای تصمیمگیری بر اساس ارزشهای انسان محور) نمیپردازند. اتحادیه اروپا قصد دارد برنامه ها را بر اساس خطری که برای عموم ایجاد می کند طبقه بندی کند. قانون هوش مصنوعی چین اضافه کردن یا ایجاد مکانیسمهای فیلتر (مانند سیستمهای مدیریتی برای بررسی الگوریتمها و ارائه حفاظت از کاربر و کودک) را از طریق یک LLM نظارتی که برای پاکسازی اطلاعات غیرقانونی، غیر اختصاصی و ناخواسته طراحی شده است، توصیه میکند. هر دوی این رویکردها به شدت با تلاشهای قانونگذاری در ایالات متحده تضاد دارند، جایی که معمولاً اصولی پیشنهاد میشود که نحوه طراحی یا استفاده از هوش مصنوعی از طریق نردههای محافظ نظارتی را راهنمایی میکند.

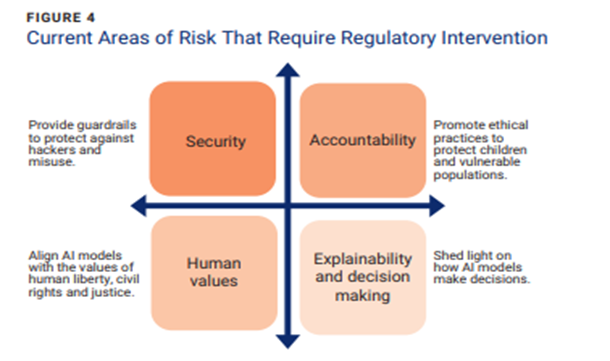

تمام مداخلات نظارتی فعلی توسط دولتها و تنظیمکنندههایی که انگیزه زیادی برای مدیریت حوزههای خاص خطر داشتند، انجام شد. این مناطق بر اساس نوع ریسک (تولید شده توسط هوش مصنوعی و ML) و نتایج خاص مورد انتظار در پاسخ به مقررات شناسایی می شوند. شکل 4 چهار منطقه خطر را به تصویر می کشد که توسط مداخله نظارتی مدیریت می شود.

بهترین نتیجه از قوانین و لوایح یادگیری ماشینی و هوش مصنوعی مدلهای هوش مصنوعی خواهد بود که با ارزشهای انسانی همسو هستند، در برابر اصول غیراخلاقی محافظت میکنند و توانایی نشان دادن نحوه تصمیمگیری را دارند.

امنیت: برای محافظت در برابر هکرها و سوء استفاده از نرده های محافظ تهیه کنید

ارزش های انسانی: مدلهای هوش مصنوعی را با ارزشهای آزادی بشر، حقوق مدنی و عدالت هماهنگ کنید.

مسئولیت: ترویج شیوه های اخلاقی برای محافظت از کودکان و جمعیت های آسیب پذیر.

قابلیت توضیح و تصمیم گیری: نحوه تصمیم گیری مدل های هوش مصنوعی را روشن کنید.

تأثیر مطلوب مقررات هوش مصنوعی

تأثیرات مطلوب ضمنی و صریح مرتبط با پیگیری نردههای محافظ نظارتی برای اجرای عدالت در جهان هوش مصنوعی وجود دارد:

-

تأثیر دادههای کنترلنشده – نیاز به حفاظت از محل تولید داده، هدف، منبع اصلی و استناد صاحب/نویسنده آن وجود دارد. برخی مقررات (به عنوان مثال، قانون هوش مصنوعی اتحادیه اروپا، مقررات هوش مصنوعی چین) وجود دارد که این نیاز را بیان می کند، اما برخی دیگر این نیاز را ندارند. لازم است یک الزام قانونی اجباری وجود داشته باشد تا تدابیر لازم را فراهم کند.

-

تأثیر و سوگیری مربوط به ملاحظات اخلاقی و انسانی - مقررات باید سازمانها را مجبور به بررسی مدلهای هوش مصنوعی برای انواع سوگیریهایی کند که در الگوریتمهای موجود وجود دارد (به عنوان مثال، دادههای جمعیت محور که توسط منابع داده تأیید نشده هدایت میشوند) و آن الگوریتمها را اصلاح کنند. الزامات نظارتی باید انواع سوگیری ها را فهرست کند (به عنوان مثال، داده های جمعیت محور، هدایت شده توسط منابع داده تایید نشده) و الگوریتم ها باید از آنها اجتناب کنند. الگوریتم ها را می توان بر روی انواع مختلف مجموعه داده آموزش داد تا از سوگیری جلوگیری شود.

-

تأثیر اطلاعات حساس، خصوصی و به راحتی قابل دسترسی – چندین مقررات حفظ حریم خصوصی داده ها به این خطر امنیتی بالقوه پرداخته اند (به عنوان مثال، قانون هوش مصنوعی اتحادیه اروپا، مقررات هوش مصنوعی چین). با این حال، مقررات باید موظف شوند که سازمانهای هوش مصنوعی پاکسازی دادهها، پاکسازی و توانایی رمزگذاری اطلاعات شناسایی شخصی (PII) را ارائه دهند.

-

تأثیر بر آموزش کودکان – قانونگذاران و سازمانهای پیشرو هوش مصنوعی باید با یکدیگر همکاری کنند تا مدلهای فیلترینگ مخصوص هوش مصنوعی را طراحی کنند که محتوای مناسب سن را نشان میدهد، تعصبات را فیلتر میکند و حس کنجکاوی کودکان را تقویت میکند و در نتیجه به آنها کمک میکند تا به جای ارائه پاسخهای آسان به سوالاتی مانند هوش مصنوعی مولد از پاسخها بیاموزند.

-

تأثیر بر تحقیق و نوآوری - مدلهای هوش مصنوعی میتوانند بر اساس اولویتها، حوزهها، جدول زمانی و آمادگی نوآوری (توانایی اجرای سریع یک ایده) بینشهای معناداری را از مقالات تحقیقاتی، به دست آورند. در آینده، مدلهای هوش مصنوعی میتوانند با طراحی مدلهای تحقیق و توسعه بر اساس موضوع یا با تولید مدلهای نوآوری بر اساس تحقیقات موجود بر اساس موضوع، شکاف بین تحقیق و نوآوری را پر کنند. تنظیمکنندهها باید از پتانسیل هوش مصنوعی آگاه باشند و لوایح و قوانین نظارتی را ایجاد یا بهروزرسانی کنند تا امکان ایجاد اعتماد به دادهها و کارایی مدلهای خلاقانه هوش مصنوعی را فراهم کنند.

-

تأثیر بر علوم زیستی (از جمله توسعه دارویی) - در حال حاضر، الگوریتمهای هوش مصنوعی وجود دارد که شناسایی اجزای دارویی بالقوه را که ممکن است در فرمولبندی داروها برای برخی بیماریهای تهدیدکننده حیات ضروری باشند، تسریع میکنند. همچنین مدلهایی وجود دارند که به تقلید از پزشک کمک میکنند. مشاوره هایی که نزدیک به 70 تا 80 درصد دقیق هستند. کلید تنظیم کننده ها دستیابی به اعتماد و دقت داده ها از طریق ممیزی این مدل ها به صورت دوره ای است. این فرآیند بسیار شبیه به حسابرسی قانونی یا بازرسی در محل است.

-

تأثیر آینده بر دستگاه ها (به هم پیوسته) - جهان پیچیده و متصل است. دادههای ساعت هوشمند (اندازهگیری دادههای سلامت) میتوانند روی همان سرویس ابری قرار بگیرند که دستگاههای خانه هوشمند ممکن است با استفاده از آدرس ایمیل یکسان به اشتراک بگذارند. به دلیل اتصال اجتنابناپذیر کاربر و دستگاه، بین دادهها، ضروری است که تنظیمکنندهها شروع به در نظر گرفتن تمام نرمافزارهای هوش مصنوعی در دستگاههای اولیه و ثانویه و مداخله نظارتی (از طریق مدلهای هوش مصنوعی نظارتی یا فیلترهای اضافی برای تعصب مسائل خصوصی) نمایند.

آینده مقررات هوش مصنوعی چه خواهد بود؟

مسائلی که برای اطمینان از اثربخشی مقررات فعلی و آتی هوش مصنوعی باید فورا مورد توجه قرار گیرند عبارتند از:

- آگاهی و آموزش برای تنظیم کننده ها در مورد انواع و کاربردهای مدل های هوش مصنوعی

- در نظر گرفتن کاربرد فعلی داده ها، الگوریتم ها و مدل ها در سراسر جهان در پرتو ریسک. ارائه یک رویکرد لایهای به خود تنظیمی - نه تنها توسط تنظیمکنندهها، بلکه بر اساس بازخورد صنعت، مردم و سازمانها - برای فعال کردن مداوم بازخورد و بهبود

- ایجاد کنسرسیومی از تنظیمکنندهها که میتوانند در مورد شکافهای موجود در قوانین نظارتی فعلی (مانند شفافیت دادهها و تصمیمگیری در مدلهای هوش مصنوعی) و نحوه رسیدگی به این شکافها در کوتاهمدت، میانمدت و بلندمدت صحبت کنند.

- همسویی مداوم و دوره ای نهادهای نظارتی و صنعتی بر تأثیر هوش مصنوعی با بحث در مورد چالش ها و راه حل ها. هماهنگیها میتواند ناشی از ملاقات نهادهای نظارتی دولتی، ایالتی یا محلی با سازمانها، شرکتها و مشاورانی باشد که در توسعه و پیادهسازی ابزارهای یادگیری ماشینی و هوش مصنوعی کار میکنند.

نتیجه

آینده مداخله نظارتی برای هوش مصنوعی و یادگیری ماشینی مانند جاده ای طولانی و پر پیچ و خم به نظر می رسد. دست اندرکاران صنعت و تنظیم کنندگان با تشکیل کنسرسیومی و شرکت در پروژه های مشترک می توانند به طور مستمر بر مقررات موجود نظارت داشته باشند، به طوری که نرده های محافظ برای اجرای ابزارهای هوش مصنوعی به وضوح شناسایی و اجرا شوند، و به تدوین آن کمک خواهند کرد.

توجه داشته باشید

جزئیات مقررات مندرج در این مقاله ممکن است تا زمان انتشار تغییر کرده باشد اما در زمان نگارش دقیق بوده است.